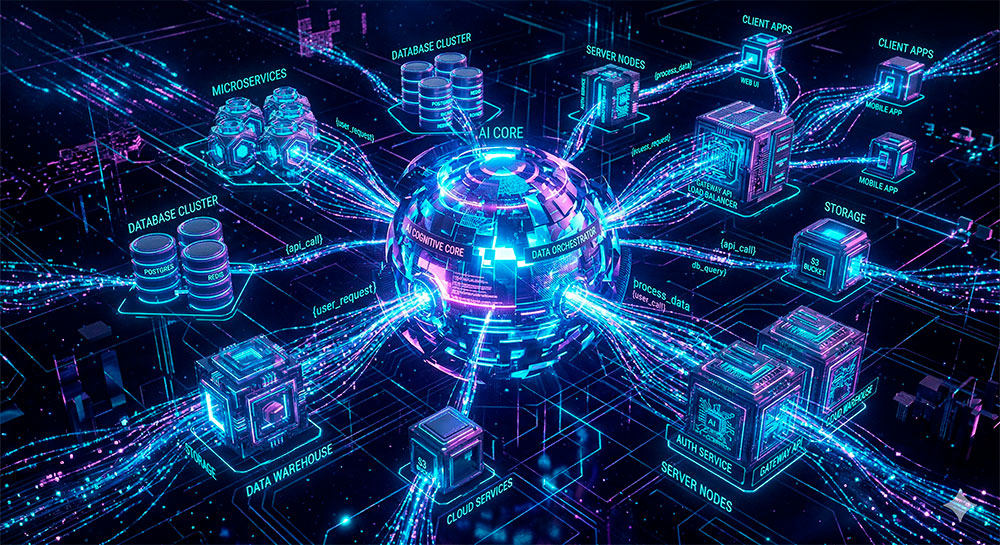

La integración de Modelos de Lenguaje Grande (LLMs) en aplicaciones comerciales está cambiando radicalmente la forma en que los informáticos y desarrolladores diseñan la arquitectura de software. Ya no basta con tener una base de datos y un frontend; ahora debes gestionar “cerebros” externos.

Del Monolito a los Microservicios impulsados por IA

Cuando integras IA (como la API de OpenAI o modelos locales como Ollama), la arquitectura monolítica tradicional se vuelve un cuello de botella.

- Latencia y Asincronía: Las llamadas a una API de IA pueden tardar varios segundos (un tiempo eterno en informática). La arquitectura moderna exige el uso de colas de mensajes (como RabbitMQ o Kafka) y procesos en segundo plano (WebSockets) para no bloquear la experiencia del usuario mientras la IA “piensa”.

- Bases de Datos Vectoriales: Las bases de datos relacionales (SQL) son excelentes para datos estructurados, pero la IA necesita buscar por “significado”. Aquí entran las bases de datos vectoriales (como Pinecone o Milvus), que almacenan la información como coordenadas matemáticas, permitiendo la Generación Aumentada por Recuperación (RAG).

- Orquestación de Prompts: Surgen nuevas capas en la arquitectura, como LangChain o LlamaIndex, que actúan como middleware para encadenar múltiples llamadas a la IA, gestionar el historial de conversación y conectar los modelos con fuentes de datos externas de forma segura.

Diseñar software hoy implica construir sistemas que sean resilientes, modulares y capaces de manejar la imprevisibilidad inherente a las respuestas de la Inteligencia Artificial.